NVIDIA H100 NVL: Një ndryshim i lojës në llogaritjen e përshpejtuar

Prezantimi i Njësive të Përpunimit Grafik (GPU) revolucionarizoi industrinë e kompjuterave, me NVIDIA që kryeson diskun. Oferta më e fundit e kompanisë, NVIDIA H100 NVL, është një dëshmi e përkushtimit të saj për të shtyrë kufijtë e asaj që është e mundur në llogaritjen e përshpejtuar.

Përmbajtje

- Performancë dhe shkallëzim të paparë

- Konkluzioni i modelit të gjuhës së madhe të NVIDIA H100 NVL

- Ndërmarrja AI Adoptimi i NVIDIA H100 NVL

- Përshpejtimi i sigurt i ngarkesave të punës

- Konkluzioni i mësimit të thellë në kohë reale të NVIDIA H100 NVL

- Informatikë me performancë të lartë Exascale

- Analiza e përshpejtuar e të dhënave NVIDIA H100 NVL

- Përdorimi i gatshëm për ndërmarrje

- Informatikë konfidenciale e integruar me NVIDIA H100 NVL

- Performancë e pashembullt për AI dhe HPC në shkallë të gjerë

- Specifikimet e produktit

- Mendimi përfundimtar

- Video në Youtube Rreth NVIDIA H100 NVL

- FAQ

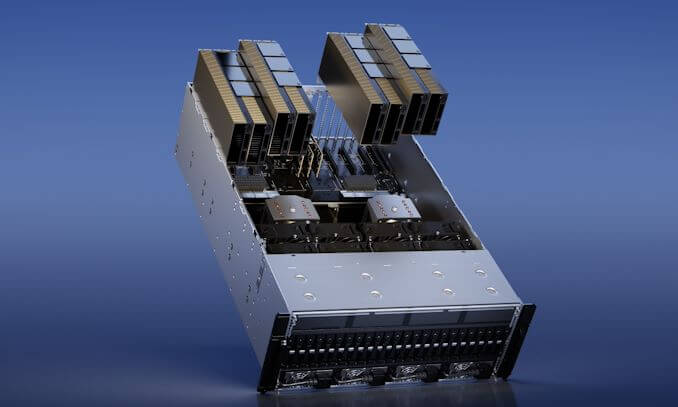

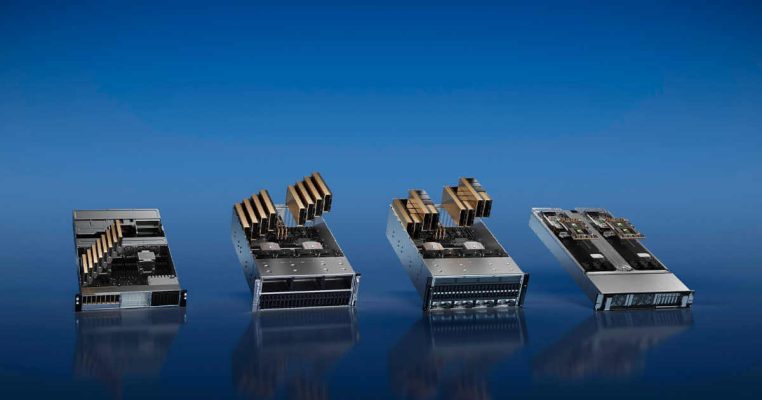

Performancë dhe shkallëzim të paparë

La NVIDIA H100 NVL është një mrekulli e teknologjisë moderne, që ofron performancë, shkallëzim dhe siguri të paparë.

Sistemi NVIDIA NVLink Switch e lejon atë të menaxhojë çdo ngarkesë pune me lehtësi. Ky sistem mundëson ndërlidhjen e deri në 256 GPU H100, duke rezultuar në një rritje të ndjeshme të aftësive të përshpejtuara të llogaritjes.

Për më tepër, NVIDIA NVL ka një motor të specializuar transformues. Gjithashtu ky motor synon të trajtojë modele gjuhësore me trilion parametra, një detyrë që shumica e GPU-ve do ta kishin të vështirë.

Zbulimet e kombinuara teknologjike të NVIDIA H100 NVL mund të përshpejtojnë modelet e mëdha të gjuhës (LLM) me një 30X mahnitës në krahasim me gjeneratën e mëparshme, duke e bërë gjithashtu një lider në AI bisedore.

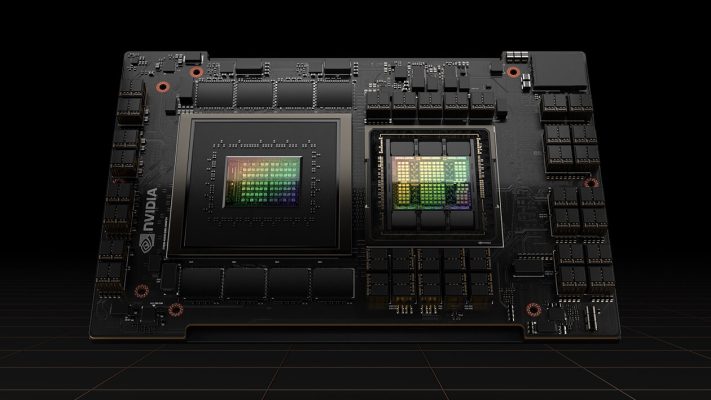

Konkluzioni i modelit të gjuhës së madhe të NVIDIA H100 NVL

La NVIDIA H100 NVL nuk ka të bëjë vetëm me fuqinë e papërpunuar; ka të bëjë edhe me finesën. NVIDIA H100 me urën NVLink ofron performancë optimale për LLM-të me deri në 175 miliardë parametra duke përdorur motorin e tij Transformer, NVLink dhe memorien 188 GB HBM3.

Gjithashtu ky kombinim mundëson shkallëzim të thjeshtë në çdo qendër të dhënash, duke futur LLM-të në rrjedhën kryesore.

Serverët e pajisur me GPU NVIDIA H100 NVL mund të rrisin performancën e modelit GPT-175B deri në 12X mbi sistemet NVIDIA DGX A100.

Kjo rritje e performancës realizohet duke ruajtur vonesën e ulët në skenarët e qendrës së të dhënave me kufizim të energjisë, duke demonstruar efikasitetin e H100 NVL.

Ndërmarrja AI Adoptimi i NVIDIA H100 NVL

Miratimi i AI në ndërmarrje është tashmë i përhapur dhe organizatat kanë nevojë për infrastrukturë të gatshme për inteligjencë artificiale. Të NVIDIA H100 NVL GPU-të për serverët e zakonshëm vijnë me një abonim pesë-vjeçar, duke përfshirë mbështetjen e ndërmarrjes, në paketën e softuerit NVIDIA AI Enterprise.

Kjo paketë thjeshton adoptimin e AI duke siguruar që organizatat të kenë akses në kornizat dhe teknologjitë e AI që kërkohen për të ndërtuar procese të përshpejtuara nga AI, të tilla si chatbots AI, motorët e rekomandimeve, vizioni AI, dhe më shumë.

Përshpejtimi i sigurt i ngarkesave të punës

La NVIDIA H100 NVL nuk ka të bëjë vetëm me performancën dhe shkallëzueshmërinë; ka të bëjë edhe me sigurinë. GPU-ja ka për qëllim të përshpejtojë në mënyrë të sigurt ngarkesat e punës duke filluar nga korporata në shkallë.

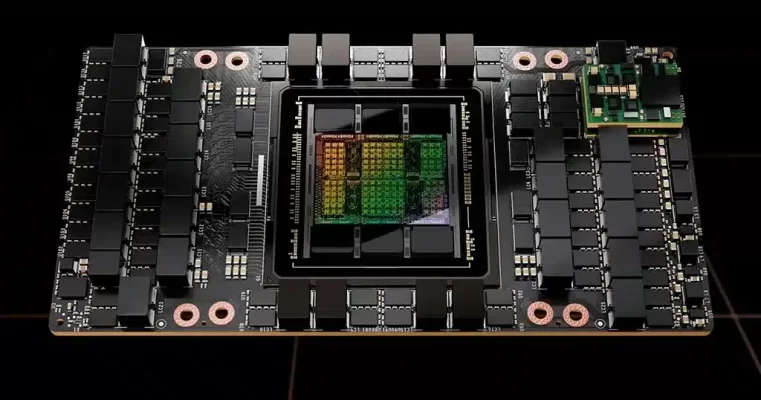

Ka bërthama tensor të gjeneratës së katërt dhe një motor transformator me saktësi FP8, duke lejuar trajnime deri në 4 herë më të shpejtë për modelet GPT-3 (175B) sesa përsëritja e mëparshme.

Kombinimi i gjeneratës së katërt NVLink, i cili siguron 900 GB/s ndërlidhje GPU-GPU; Rrjetëzimi NDR Quantum-2 InfiniBand, i cili përshpejton komunikimin nga çdo GPU nëpër nyje; PCIe Gen5; dhe softueri NVIDIA Magnum IO mundëson shkallëzim efikas nga sistemet e ndërmarrjeve të vogla në grupe masive, të unifikuara GPU.

Konkluzioni i mësimit të thellë në kohë reale të NVIDIA H100 NVL

La NVIDIA H100 NVL zgjeron lidershipin e konkluzioneve të NVIDIA-s në treg me disa përparime që përshpejtojnë përfundimin deri në 30X dhe japin vonesën më të ulët.

Bërthamat Tensor të gjeneratës së katërt përshpejtojnë të gjitha saktësitë, duke përfshirë FP64, TF32, FP32, FP16, INT8 dhe tani FP8, duke reduktuar përdorimin e kujtesës dhe duke rritur performancën duke ruajtur saktësinë LLM.

Informatikë me performancë të lartë Exascale

La NVIDIA H100 NVL trefishon operacionet me pikë lundruese për sekondë (FLOPS) të bërthamave tensor me precizion të dyfishtë, duke ofruar 60 teraflops të llogaritjes FP64 për HPC. Aplikacionet HPC të infektuara me AI mund të përdorin gjithashtu saktësinë TF100 të H32 për të arritur një petaflop të performancës për operacionet e shumëzimit të matricës me saktësi të vetme, ndërkohë që nuk kërkojnë modifikime të kodit.

Analiza e përshpejtuar e të dhënave NVIDIA H100 NVL

La NVIDIA H100 NVL jep fuqinë llogaritëse – së bashku me 3 terabajt për sekondë (TB/s) të gjerësisë së brezit të memories për GPU dhe shkallëzueshmërinë me NVLink dhe NVSwitch – për të trajtuar analitikën e të dhënave me performancë dhe shkallë të lartë për të mbështetur grupe të dhënash masive.

Arkitektura e qendrës së të dhënave NVIDIA, kur kombinohet me NVIDIA Quantum-2 InfiniBand, softuerin Magnum IO, Spark 3.0 të përshpejtuar nga GPU dhe NVIDIA RAPIDS, është e pajisur në mënyrë unike për të përshpejtuar këto ngarkesa masive të punës me nivele të patejkalueshme të performancës dhe efikasitetit.

Përdorimi i gatshëm për ndërmarrje

NVIDIA H100 NVL përfshin teknologjinë e gjeneratës së dytë GPU me shumë instanca (MIG), e cila maksimizon përdorimin e GPU-së duke e ndarë atë në mënyrë të sigurt deri në shtatë instanca të ndryshme.

Gjithashtu me mbështetje konfidenciale kompjuterike, NVIDIA H100 NVL lejon përdorimin e sigurt, nga fundi në fund, me shumë qiramarrës, duke e bërë atë ideal për mjediset e ofruesit të shërbimit cloud (CSP).

Informatikë konfidenciale e integruar me NVIDIA H100 NVL

NVIDIA Confidential Computing është një veçori e integruar e sigurisë e arkitekturës Hopper që e bën atë NVIDIA H100 NVL përshpejtuesi i parë në botë me aftësi konfidenciale llogaritëse.

Përdoruesit mund të ruajnë sigurinë dhe integritetin e të dhënave dhe aplikacioneve të tyre duke përfituar nga përshpejtimi i pakrahasueshëm i GPU-ve H100.

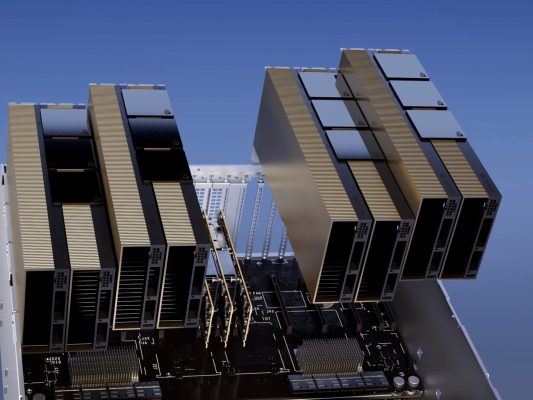

Performancë e pashembullt për AI dhe HPC në shkallë të gjerë

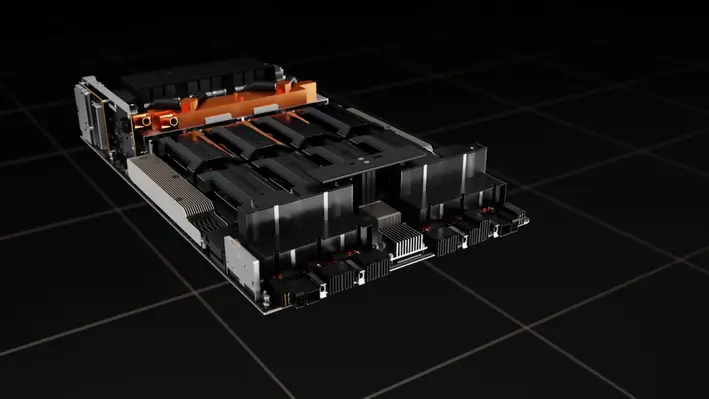

Arkitektura NVIDIA Grace Hopper CPU+GPU, e ndërtuar me qëllim për llogaritje të përshpejtuara në shkallë terabyte dhe që mundëson performancë 10X më të madhe në AI dhe HPC të modeleve të mëdha, gjithashtu do të mundësohet nga GPU Hopper Tensor Core.

CPU NVIDIA Grace përdor fleksibilitetin e arkitekturës Arm për të prodhuar një arkitekturë CPU dhe server të krijuar nga poshtë lart për llogaritje të përshpejtuara.

GPU-ja Hopper është e lidhur me CPU-në Grace përmes ndërfaqes ultra të shpejtë të çipit në çip të NVIDIA, e cila siguron 900 GB/s gjerësi bande, e cila është 7X më e shpejtë se PCIe Gen5.

Specifikimet e produktit

Këtu është një tabelë krahasuese e H100 NVL në forma të ndryshme:

| Faktori formë | FP64 | Bërthama tensore FP64 | FP32 | Bërthama e tensorit TF32 | BFLOAT16 Bërthama tensore | Kujtesa GPU | Gjerësia e brezit të memories GPU |

| H100 SXM | 34 teraFLOPS | 67 teraFLOPS | 67 teraFLOPS | 989 teraFLOPS | 1,979 teraFLOPS | 80GB | 3.35 TB/s |

| H100 PCIe | 26 teraFLOPS | 51 teraFLOPS | 51 teraFLOPS | 756 teraFLOPS | 1,513 teraFLOPS | 80GB | 2 TB/s |

| H100 NVL | 68 teraFLOPS | 134 teraFLOPS | 134 teraFLOPS | 1,979 teraFLOPS | 3,958 teraFLOPS | 188GB | 7.8 TB/s |

Mendimi përfundimtar

La NVIDIA H100 NVL është një ndryshim i lojës në botën e informatikës së përshpejtuar. Performanca, shkallëzueshmëria dhe siguria e tij do të transformojnë AI, HPC dhe gjithashtu analitikën e të dhënave. Llogaritja me fuqi H100 NVL është e ardhmja.

H100 NVL tregon përkushtimin e NVIDIA për llogaritjen e përshpejtuar duke mbingarkuar konkluzionet e modelit të gjuhës së madhe dhe gjithashtu duke ofruar llogaritje sekrete. H100 NVL do të formësojë të ardhmen e informatikës.

Video në Youtube Rreth NVIDIA H100 NVL

Ju mund të dëshironi

Përfitimet e Cloud Computing për bizneset e vogla

10 lojërat më të mira kompjuterike të të gjitha kohërave

FAQ

Tensor Core GPU H100 NVL ofron performancë, shkallëzim dhe siguri të pakrahasueshme. Sistemi NVIDIA NVLink Switch lidh deri në 256 GPU H100, gjithashtu Transformer Engine trajton modele gjuhësore me trilion parametra, dhe llogaritja sekrete është e integruar. Siguron përshpejtimin e ngarkesës së punës nga ndërmarrja në shkallë.

H100 NVL me urën NVLink optimizon LLM-të deri në 175 miliardë parametra duke përdorur motorin e tij Transformer, NVLink dhe memorien 188 GB HBM3. Gjithashtu ky kombinim i bën LLM-të kryesore duke mundësuar shkallëzueshmëri në të gjithë qendrën e të dhënave.

Softueri NVIDIA AI Enterprise me performancë të lartë thjeshton adoptimin e AI. GPU-të H100 NVL për serverët e zakonshëm vijnë me një abonim pesë-vjeçar dhe gjithashtu mbështetje për ndërmarrjet. Kjo paketë ofron korniza dhe mjete të procesit të AI të përshpejtuar nga H100 për organizatat.

Teknologjia e gjeneratës së dytë të GPU-së me shumë instanca (MIG) e H100 NVL ndan në mënyrë të sigurt çdo GPU në shtatë raste për të maksimizuar përdorimin e GPU-së. Gjithashtu, kjo siguron përdorim nga fundi në fund, me shumë qiramarrës, duke e bërë atë të përsosur për situatat e ofruesit të shërbimit cloud (CSP).

Arkitektura NVIDIA Grace Hopper CPU+GPU përshpejton AI dhe HPC 10X të modelit të madh. Arkitektura Arm i lejon CPU-së NVIDIA Grace të ndërtojë një arkitekturë CPU dhe server të optimizuar për llogaritje të përshpejtuara. Lidhja ultra e shpejtë e çipit me çip të NVIDIA lidh CPU-në Grace dhe GPU-në Hopper, duke dhënë 900 GB/s gjerësi brezi, 7X më shpejt se PCIe Gen5.